2018年下半年,别错过这些深度学习项目!

2018-12-21 来源:raincent

深度学习现在是一个非常火爆的领域,很难对其快速的发展一一记录。

今年早些时候,作为尝试记录深度学习领域进展的第一步,本文作者Ross Taylor创建了网站Papers With Code。该网站是一个将深度学习研究论文与其实现代码相连接的社区。

Papers With Code:www.paperswithcode.com

这个网站也使得作者对深度学习领域有了一个全面的了解。基于此,通过本文我们可以看到AI的研究趋势是什么,社区正在采用哪些框架,以及哪些技术正在受到青睐。

最受欢迎的发布:BERT,vid2vid和graph_nets

Google AI的BERT论文在10月份引起了深度学习界的关注。本文提出了一种深度双向编码器模型,该模型可实现11种NLP任务的最先进性能,包括斯坦福问答(SQUAD)数据集。 Google AI开源了他们论文的代码,这是深度学习库类别中,获得最多的“星星”的开源代码。

论文下载地址:https://arxiv.org/abs/1810.04805

论文代码:https://github.com/google-research/bert

NVIDIA的一篇关于视频到视频合成的论文,是生成建模的又一个惊人结果,生成模型是过去几年中最受欢迎的深度学习领域之一。该文利用新颖的顺序生成器体系结构,以及诸如前景和背景先验等许多其他设计特征,修复了时间不连贯的问题、提高性能。 NVIDIA开源了他们的代码,欢迎程度位居第二。

论文下载地址:https://arxiv.org/abs/1808.06601/

代码地址:https://github.com/NVIDIA/vid2vid/

谷歌DeepMind关于图形网络的论文在今年年中受到了很多关注。图形网络是深度学习开始尝试的新型结构化数据(大多数深度学习应用都是基于向量和序列)。此开源库的受欢迎程度排列第三。

论文下载地址:https://arxiv.org/abs/1806.01261v3

代码:https://github.com/deepmind/graph_nets/

最受欢迎的社区:DeOldify,BERT和Fast R-CNN

DeOldify

DeOldify使用SA-GAN,这是一个从PG-GAN获得灵感的架构,应用两个时间尺度的更新规则。

DeOldify项目非常迷人。作者Jason Antic复现了许多生成建模领域的论文,包括自注意力GAN,逐步增长的GAN和两个时间尺度的更新规则。在撰写本文时,该项目的代码在GitHub上有超过4,000颗星。

DeOldify:https://github.com/jantic/DeOldify

BERT

基于PyTorch框架而实现的BERT也非常受欢迎。深度学习社区不断涌现的代码往往不是基于Tensorflow就是基于PyTorch,同时用两个框架实现的需求越来越大,这样可以方便整个深度学习社区使用它们。 作者Junseong Kim的工作清楚地说明了这一点。目前,这个项目的代码在github上享有超过1,500个星星。

BERT:https://github.com/codertimo/bert-pytorch

Mask R-CNN

最后,Waleed Abdulla的基于Keras / TensorFlow实现Mask R-CNN是GitHub第三个获得星数最多的代码。在架构上,该实现使用特征金字塔网络和ResNet101基础网络,并且该库可用于许多应用,例如3D建筑物重建,自动驾驶汽车的物体检测,地图中的建筑物类型探测等。该库在GitHub上有超过8,000颗星。

论文下载地址:https://arxiv.org/abs/1703.06870

代码:https://github.com/matterport/Mask_RCNN

最热门应用:NLP和GAN

在前50个流行的实现应用中,生成模型和自然语言处理(NLP)是两大最热门领域。对生成模型而言,GitHub上的流行实现包括:vid2vid,DeOldify,CycleGAN和faceswaps。而在NLP中,流行的GitHub库包括BERT,HanLP,jieba,AllenNLP和fastText。

7篇新论文中1篇有代码

你的研究没有代码,你在社区上就不会备受关注,规则就是这样简单。以下是作者分析他自己平台上的论文代码复现情况:

分析基数是过去5年中60,000多份机器学习论文,在6万篇论文中,将近12%有代码实现。在过去的6个月中,约15%的新发表论文(即七分之一的论文)都发布了实现代码。

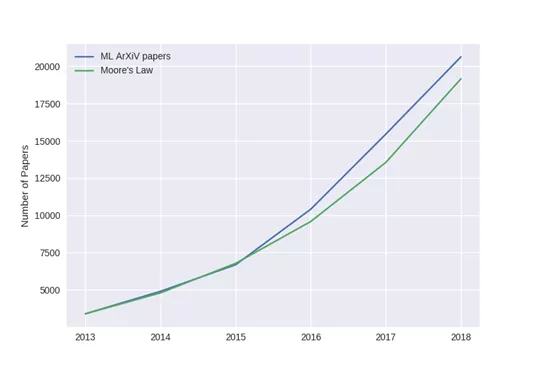

每隔20分钟,就有一篇新的机器学习论文

自7月以来,机器学习论文的增长率一直在每月3.5%左右,以此计算,每年的增长率约为50%。这意味着每月大约2,200篇机器学习论文,预计明年将有大约30,000篇新的机器学习论文。

在过去3年中,作者网站上的机器学习论文的数量似乎比摩尔定律的增长速度更快,这让你感觉人们相信这将是未来计算技术价值的出处。

框架双头垄断:TensorFlow和PyTorch

虽然PyTorch并不落后,但网站上的大多数实现似乎都是基于TensorFlow的。其他的框架(MXNet,Torch和Caffe2)在生态系统中的存在要小得多。鉴于两个框架中都发生了变化:TensorFlow正朝着即刻执行和由Keras激发灵感的新API方向发展;PyTorch则希望能够更轻松地把模型产品化。

相关报道:https://medium.com/atlas-ml/state-of-deep-learning-h2-2018-review-cc3e490f1679

版权申明:本站文章部分自网络,如有侵权,请联系:west999com@outlook.com

特别注意:本站所有转载文章言论不代表本站观点!

本站所提供的图片等素材,版权归原作者所有,如需使用,请与原作者联系。