Redis实战--使用Jedis实现百万数据秒级插入

2019-11-19 16:03:11来源:博客园 阅读 ()

Redis实战--使用Jedis实现百万数据秒级插入

echo编辑整理,欢迎转载,转载请声明文章来源。欢迎添加echo微信(微信号:t2421499075)交流学习。 百战不败,依不自称常胜,百败不颓,依能奋力前行。――这才是真正的堪称强大!!!

当我们使用普通方法插入大量数据到Redis的时候,我们发现,我们的插入数据并没有Redis宣传的那么快,号称有10w吞吐量的Redis为什么会在我们插入大量的数据的时候很慢呢?这就是本文要做说明的地方

10w吞吐量,大量插入没有得到体现?

Redis号称有10w的吞吐量,但是我们使用普通方法插入的时候,我们发现并没有达到这样的数据,主要原因是我们插入的时候多次连接操作,创建连接需要时间,同时,一个连接就会由一个数据包,多个数据包的传送网络并不能保证一致,这些都是影响我们大量数据插入性能的。

怎么样实现打完数据秒级插入?

使用Pipeline

实现代码如下:

// 在pom依赖中添加jedis依赖

<dependency>

<groupId>redis.clients</groupId>

<artifactId>jedis</artifactId>

<version>2.9.0</version>

</dependency>

// 使用jedis实现pipeline调用

public static void main(String[] args) {

Jedis jedis = new Jedis("192.168.222.135", 6379);

Pipeline pipeline = jedis.pipelined();

long startTime = System.currentTimeMillis();

IntStream.range(0, 1000000).forEach(it -> pipeline.set("batch" + it, it + ""));

pipeline.syncAndReturnAll();

long endTime = System.currentTimeMillis();

System.out.println(endTime - startTime);

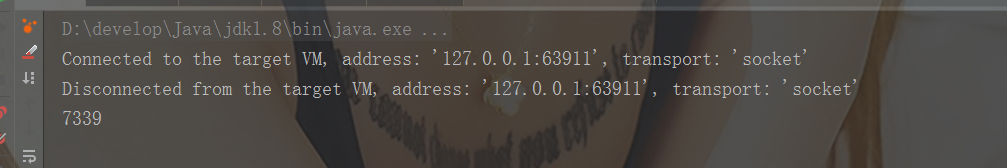

}实测插入速度如下:

实现原理

pipeline其实就是在我们的操作中节省了很多的I/O操作,将我们多个get或者set操作的I/O操作变成一个I/O操作,节省了很多的I/O时间。同时,让我们的网络影响I/O数据包传输的问题减到最小。

注意

如果我们的redis有密码,那么我们上面的代码需要加一行设置密码

jedis.auth("密码");做一个有底线的博客主

原文链接:https://www.cnblogs.com/xlecho/p/11886881.html

如有疑问请与原作者联系

标签:

版权申明:本站文章部分自网络,如有侵权,请联系:west999com@outlook.com

特别注意:本站所有转载文章言论不代表本站观点,本站所提供的摄影照片,插画,设计作品,如需使用,请与原作者联系,版权归原作者所有

- redis缓存 2020-06-12

- 掌握SpringBoot-2.3的容器探针:实战篇 2020-06-11

- Spring Boot 2.3.0 新特性Redis 拓扑动态感应 2020-06-11

- 作为一个面试官,我想问问你Redis分布式锁怎么搞? 2020-06-10

- Java框架之Hibernate实战篇 2020-06-09

IDC资讯: 主机资讯 注册资讯 托管资讯 vps资讯 网站建设

网站运营: 建站经验 策划盈利 搜索优化 网站推广 免费资源

网络编程: Asp.Net编程 Asp编程 Php编程 Xml编程 Access Mssql Mysql 其它

服务器技术: Web服务器 Ftp服务器 Mail服务器 Dns服务器 安全防护

软件技巧: 其它软件 Word Excel Powerpoint Ghost Vista QQ空间 QQ FlashGet 迅雷

网页制作: FrontPages Dreamweaver Javascript css photoshop fireworks Flash