java����Ҫ���ǵ�centos�����Ż�

2020-04-04 16:04:03��Դ������ �Ķ� ()

java����Ҫ���ǵ�centos�����Ż�

��Ϊһ����ũ��������windows������������ʵ������ʱ�����ʱ������linux�²������еģ�������һЩ���ڴ˼�¼��������ͨʶ�Ե�֪ʶ�������������ĸ��ʴ�

�ȼ����£�����������windows xp��java�������õ�jdk1.4��tomcat5����������������windows server 2003 ��windows server 2008����������linux���ռ��ʹ��ڻ���������ת�Ƶ���centos������������ȻҲ������jdk�汾�Ĺ�����Ǩ��1.4��1.6��1.8����tomcatҲ����ˣ�5,6,7�����м�Ҳ�õ���weblogic��������Ǯ����oracle 11g��������Ǯ���м�������ݶ������棩��

��װ��ɾ��IJ���ϵͳ��֪�����ڵ��ƻ��������Ż�û�У���������ecs����Ĭ�ϲ��������Linux�Ը߲���֧�ֲ����ã���Ҫ�����ڵ����������ļ������ơ��ں�TCP���������IO�¼�������Ƶȣ���ʹӼ�����������ʹLinuxϵͳ�ܹ�֧�ָ߲����ij�����

1. ��˵˵���ֵ����⣺to many open files�������Һþ��Ų�java����ȴ��os����ģ������ͨ��log��־�Ų�����ʱ��Ϊ��java���������ֵ�bug��������������Ӣ�����ϲ�֪������ϵͳ����ҲҪ�����õġ�

��Linuxƽ̨�ϣ����۱�д�ͻ��˳����Ƿ���˳����ڽ��и߲���TCP���Ӵ���ʱ����ߵIJ���������Ҫ�ܵ�ϵͳ���û���һ����ͬʱ�ɴ��ļ�����������(������ΪϵͳΪÿ��TCP���Ӷ�Ҫ����һ��socket�����ÿ��socket���ͬʱҲ��һ���ļ����)����ʹ��ulimit����鿴ϵͳ������ǰ�û����̴��ļ������ƣ�

����java����Ŀ�����Ա��ϵͳ����Ա�����Ҫ��ע�²�����open files�� max user processes��

open files: ��ʾ��ǰ�û���ÿ�������������ͬʱ��1024���ļ�����1024���ļ��л��ó�ȥÿ�����̱�Ȼ�ı����룬��������������������� socket�����̼�ͨѶ��unix��socket���ļ�����ôʣ�µĿ����ڿͻ���socket���ӵ��ļ�����ֻ�д��1024-10=1014�����ҡ�Ҳ����˵ȱʡ����£�����Linux��ͨѶ�����������ͬʱ1014��TCP�������ӡ�

������֧�ָ���������TCP�������ӵ�ͨѶ�������ͱ�����Linux�Ե�ǰ�û��Ľ���ͬʱ���ļ�������������(soft limit)��Ӳ����(hardlimit)��������������ָLinux�ڵ�ǰϵͳ�ܹ����ܵķ�Χ�ڽ�һ�������û�ͬʱ���ļ�����Ӳ�������Ǹ���ϵͳӲ����Դ״��(��Ҫ��ϵͳ�ڴ�)���������ϵͳ����ͬʱ���ļ�������ͨ��������С�ڻ����Ӳ���ơ�

Java����file descriptor table��FD����������ͨ������ lsof -p $java_pid | wc -l �鵽��

��ͨ�����·�ʽ�ĸ�ֵ��

��һ�����༭ /etc/security/limits.conf ����������

vi /etc/security/limits.conf

#����

* soft nofile 4096

* hard nofile 4096

#Ȼ��’ע�� *’�ű�ʾ�������û���Ҳ����ָ�������û��������е��м��ת���ᴴ��Ĭ���û��������ƣ�soft��hardָ��Ҫ�������ƻ���Ӳ���ƣ�4096��ָ������Ҫ�ĵ��µ�����ֵ���������ļ���(��ע��������ֵҪС�ڻ����Ӳ����)��������ļ���

�ڶ������༭/etc/pam.d/login�ļ������ļ������������У�

vi /etc/pam.d/login

#����

session required /lib/security/pam_limits.so

���Ǹ���Linux���û����ϵͳ��¼��Ӧ�õ���pam_limits.soģ��������ϵͳ�Ը��û���ʹ�õĸ�����Դ�������������(�����û��ɴ�����ļ�������)����pam_limits.soģ��ͻ��/etc/security/limits.conf�ļ��ж�ȡ������������Щ����ֵ���������ļ���

���������鿴Linuxϵͳ���������ļ������ƣ�ʹ���������

cat /proc/sys/fs/file-max

#���187932��ֵ������̨Linuxϵͳ�������ͬʱ��(�����������û����ļ����ܺ�)�ļ�������Linuxϵͳ��Ӳ���ƣ������û����Ĵ��ļ������ƶ���Ӧ���������ֵ��ͨ�����ϵͳ��Ӳ������Linuxϵͳ������ʱ����ϵͳӲ����Դ״�������������ѵ����ͬʱ���ļ������ơ�

���û��������Ҫ����Ӧ���Ĵ����ƣ�������Ϊ�û������ļ����������ó��������Ƶ�ֵ���Ĵ�Ӳ���Ƶķ�������/etc/sysctl.conf�ļ���fs.file-max= 187932

������Linux��������ɺ�ǿ�н�ϵͳ�����ļ���Ӳ��������Ϊ187932���������ļ���

����������������ϵͳ��һ������¾Ϳ��Խ�Linuxϵͳ��ָ���û��ĵ�һ��������ͬʱ������ļ���������Ϊָ������ֵ�������������ulimit-n����鿴�û��ɴ��ļ���������Ȼ�����������������õ����ֵ�����������Ϊ���û���¼�ű�/etc/profile��ʹ��ulimit-n�����Ѿ����û���ͬʱ���ļ����������ơ�����ͨ��ulimit-n��ϵͳ���û���ͬʱ���ļ������������ʱ�����ĵ�ֵֻ��С�ڻ�����ϴ�ulimit-n���õ�ֵ��������ô����������������ֵ�Dz����ܵġ����ԣ����������������ڣ���ֻ��ȥ��/etc/profile�ű��ļ������ļ��в����Ƿ�ʹ����ulimit-n�������û���ͬʱ������ļ�����������ҵ�����ɾ������������߽������õ�ֵ��Ϊ���ʵ�ֵ��Ȼ���ļ����û��˳������µ�¼ϵͳ���ɡ�

���ˣ���Ϊ֧�ָ߲���TCP���Ӵ�����ͨѶ�������������ڴ��ļ����������ϵͳ���ơ�

2. ���緽�棬���ִ�����tcp���Ӳ���

��Linux�ϱ�д֧�ָ߲���TCP���ӵĿͻ���ͨѶ��������ʱ����ʱ�ᷢ�־����Ѿ������ϵͳ���û�ͬʱ���ļ��������ƣ����Ի���ֲ���TCP���������ӵ�һ������ʱ����Ҳ���ɹ������µ�TCP���ӵ��������������ڵ�ԭ���ж��֡�

��һ���������������ΪLinux�����ں˶Ա��ض˿ںŷ�Χ�����ơ���ʱ����һ������Ϊʲô������TCP���ӣ��ᷢ���������connect()���÷���ʧ�ܣ��鿴ϵͳ������ʾ��Ϣ��“Can’t assign requested address”��ͬʱ������ڴ�ʱ��tcpdump���������磬�ᷢ�ָ���û��TCP����ʱ�ͻ��˷�SYN����������������Щ���˵���������ڱ���Linuxϵͳ�ں��������ơ���ʵ������ĸ���ԭ������Linux�ں˵�TCP/ipЭ��ʵ��ģ���ϵͳ�����еĿͻ���TCP���Ӷ�Ӧ�ı��ض˿ںŵķ�Χ����������(���磬�ں����Ʊ��ض˿ںŵķ�ΧΪ1024~32768֮��)��

��ϵͳ��ijһʱ��ͬʱ����̫���TCP�ͻ�������ʱ������ÿ��TCP�ͻ������Ӷ�Ҫռ��һ��Ψһ�ı��ض˿ں�(�˶˿ں���ϵͳ�ı��ض˿ںŷ�Χ������)��������е�TCP�ͻ��������ѽ����еı��ض˿ں�ռ�������ʱ����Ϊ�µ�TCP�ͻ������ӷ���һ�����ض˿ں��ˣ����ϵͳ���������������connect()�����з���ʧ�ܣ�����������ʾ��Ϣ��Ϊ“Can’t assign requested address”���й���Щ���������Բ鿴Linux�ں�Դ���룬��linux2.6�ں�Ϊ�������Բ鿴tcp_ipv4.c�ļ������º�����

static int tcp_v4_hash_connect(struct sock *sk)

��ע�����������жԱ���sysctl_local_port_range�ķ��ʿ��ơ�����sysctl_local_port_range�ij�ʼ��������tcp.c�ļ��е����º��������ã�

void __init tcp_init(void)

�ں˱���ʱĬ�����õı��ض˿ںŷ�Χ����̫С�������Ҫ�Ĵ˱��ض˿ڷ�Χ���ơ�

��һ������/etc/sysctl.conf�ļ������ļ������������У�

vi /etc/sysctl.conf

#����

net.ipv4.ip_local_port_range = 1024 65000

�������ϵͳ�Ա��ض˿ڷ�Χ��������Ϊ1024~65000֮�䡣��ע�⣬���ض˿ڷ�Χ����Сֵ������ڻ����1024�����˿ڷ�Χ�����ֵ��ӦС�ڻ����65535���������ļ���

�ڶ�����ִ��sysctl���

sysctl -p

���ϵͳû�д�����ʾ���ͱ����µı��ض˿ڷ�Χ���óɹ�������������˿ڷ�Χ�������ã��������ϵ���һ������������ͬʱ����60000���TCP�ͻ������ӡ�

�ڶ��������������TCP���ӵ�ԭ���������ΪLinux�����ں˵�IP_TABLE����ǽ�������ٵ�TCP�����������ơ���ʱ��������Ϊ�� connect()��������������ͬ�����������tcpdump���������磬Ҳ�ᷢ�ָ���û��TCP����ʱ�ͻ��˷�SYN������������������ IP_TABLE����ǽ���ں��л��ÿ��TCP���ӵ�״̬���и��٣�������Ϣ�������λ���ں��ڴ��е�conntrack database�У�������ݿ�Ĵ�С���ޣ���ϵͳ�д��ڹ����TCP����ʱ�����ݿ��������㣬IP_TABLE��Ϊ�µ�TCP���ӽ���������Ϣ�����DZ���Ϊ��connect()��������������ʱ�ͱ������ں˶������ٵ�TCP�����������ƣ�����ͬ���ں˶Ա��ض˿ںŷ�Χ�����������Ƶģ�

��һ������/etc/sysctl.conf�ļ������ļ������������У�

vi /etc/sysctl.conf

#��

net.ipv4.ip_conntrack_max = 10240

�������ϵͳ�������ٵ�TCP��������������Ϊ10240����ע�⣬������ֵҪ����С���Խ�ʡ���ں��ڴ��ռ�á�

�ڶ�����ִ��sysctl���

sysctl -p

���ϵͳû�д�����ʾ���ͱ���ϵͳ���µ������ٵ�TCP�����������ijɹ�����������������������ã��������ϵ���һ������������ͬʱ����10000���TCP�ͻ������ӡ�

����������� TCP���ӶϿ�����TIME_WAIT״̬����һ����ʱ�䣬Ȼ��Ż��ͷŶ˿ڡ���������������ʱ�ͻ����������TIME_WAIT״̬�����ӣ�����ʱ�Ͽ��Ļ�����ռ�ô����Ķ˿���Դ�ͷ�������Դ�����ʱ�����ǿ����Ż�TCP���ں˲���������ʱ��TIME_WAIT״̬�Ķ˿���������

������ܵķ���ֻ��ӵ�д���TIME_WAIT״̬�����ӵ���ϵͳ��Դ������Ч�����������������£�Ч�����ܲ����ԡ�����ʹ��netstat����ȥ��TIME_WAIT״̬������״̬������������������鿴��ǰTCP���ӵ�״̬�Ͷ�Ӧ������������

netstat -n | awk '/^tcp/ {++S[$NF]} END {for(a in S) print a, S[a]}'

�������������������Ľ����

LAST_ACK16

SYN_RECV348

ESTABLISHED70

FIN_WAIT1229

FIN_WAIT230

CLOSING33

TIME_WAIT18098

����ֻ�ù���TIME_WAIT�ĸ�������������Կ�������18000���TIME_WAIT��������ռ����18000����˿ڡ�Ҫ֪���˿ڵ�����ֻ��65535����ռ��һ����һ���������ص�Ӱ�쵽��̵������ӡ���������£����Ǿ��б�Ҫ������Linux��TCP�ں˲�������ϵͳ������ͷ�TIME_WAIT���ӡ�

�༭�����ļ�:/etc/sysctl.conf��������ļ��У���������ļ������ݣ�

# vi /etc/sysctl.conf

net.ipv4.tcp_syncookies= 1

net.ipv4.tcp_tw_reuse= 1

net.ipv4.tcp_tw_recycle= 1

net.ipv4.tcp_fin_timeout= 30

���������������ں˲�����Ч��

# sysctl-p

��˵������IJ����ĺ��壺

net.ipv4.tcp_syncookies= 1

��ʾ����SYNCookies��������SYN�ȴ��������ʱ������cookies���������ɷ�������SYN������Ĭ��Ϊ0����ʾ�رգ�

net.ipv4.tcp_tw_reuse= 1

��ʾ�������á�������TIME-WAIT sockets���������µ�TCP���ӣ�Ĭ��Ϊ0����ʾ�رգ�

net.ipv4.tcp_tw_recycle= 1

��ʾ����TCP������TIME-WAITsockets�Ŀ��ٻ��գ�Ĭ��Ϊ0����ʾ�رգ�

net.ipv4.tcp_fin_timeout

��ϵ�yĬ�ϵ�TIMEOUT ʱ�䡣

�ھ��������ĵ���֮���˻��һ�������������ĸ�������֮�⣬���ܹ�����С�����̶ȵ�DoS��CC��SYN������

���⣬�����������������ͺܶ࣬���ǿ������Ż�һ��TCP�Ŀ�ʹ�ö˿ڷ�Χ����һ�������������IJ�����������Ȼ��������IJ����ļ��У�����������Щ���ã�

net.ipv4.tcp_keepalive_time= 1200

net.ipv4.ip_local_port_range= 1024 65535

net.ipv4.tcp_max_syn_backlog= 8192

net.ipv4.tcp_max_tw_buckets= 5000

�⼸������������ֻ�������dz���ķ������Ͽ���������������Ч����һ�������С�ķ������ϣ�û�б�Ҫȥ�����⼸��������

net.ipv4.tcp_keepalive_time= 1200

��ʾ��keepalive���õ�ʱ��TCP����keepalive��Ϣ��Ƶ�ȡ�ȱʡ��2Сʱ����Ϊ20���ӡ�

ip_local_port_range= 1024 65535

��ʾ�����������ӵĶ˿ڷ�Χ��ȱʡ����º�С����Ϊ1024��65535��

net.ipv4.tcp_max_syn_backlog= 8192

��ʾSYN���еij��ȣ�Ĭ��Ϊ1024���Ӵ���г���Ϊ8192���������ɸ���ȴ����ӵ�������������

net.ipv4.tcp_max_tw_buckets= 5000

��ʾϵͳͬʱ����TIME_WAIT������������������������֣�TIME_WAIT�����̱��������ӡ������Ϣ��Ĭ��Ϊ180000����Ϊ5000������������Կ���TIME_WAIT�����������ֻҪ�����ˡ�

net.ipv4.tcp_max_syn_backlog= 65536

��¼����Щ��δ�յ��ͻ���ȷ����Ϣ��������������ֵ��������128M�ڴ��ϵͳ���ԣ�ȱʡֵ��1024��С�ڴ��ϵͳ����128��

net.core.netdev_max_backlog= 32768

ÿ������ӿڽ������ݰ������ʱ��ں˴�����Щ�������ʿ�ʱ�������͵����е����ݰ��������Ŀ��

net.core.somaxconn= 32768

����webӦ����listen������backlogĬ�ϻ�������ں˲�����net.core.somaxconn���Ƶ�128����nginx�����NGX_LISTEN_BACKLOGĬ��Ϊ511�������б�Ҫ�������ֵ��

net.core.wmem_default= 8388608

net.core.rmem_default= 8388608

net.core.rmem_max= 16777216 #���socket��buffer,�ɲο����Ż�ֵ:873200

net.core.wmem_max= 16777216 #���socketдbuffer,�ɲο����Ż�ֵ:873200

net.ipv4.tcp_timestsmps= 0

ʱ������Ա������кŵľ��ơ�һ��1Gbps����·�϶���������ǰ�ù������кš�ʱ����ܹ����ں˽�������“�쳣”�����ݰ���������Ҫ����ص���

net.ipv4.tcp_synack_retries= 2

Ϊ�˴Զ˵����ӣ��ں���Ҫ����һ��SYN������һ����Ӧǰ��һ��SYN��ACK��Ҳ������ν���������еĵڶ������֡�������þ������ں˷�������֮ǰ����SYN+ACK����������

net.ipv4.tcp_syn_retries= 2

���ں˷�����������֮ǰ����SYN����������

#net.ipv4.tcp_tw_len= 1

net.ipv4.tcp_tw_reuse= 1

�������á�������TIME-WAITsockets���������µ�TCP���ӡ�

net.ipv4.tcp_wmem= 8192 436600 873200

TCPдbuffer,�ɲο����Ż�ֵ:8192 436600 873200

net.ipv4.tcp_rmem = 32768 436600 873200

TCP��buffer,�ɲο����Ż�ֵ:32768 436600 873200

net.ipv4.tcp_mem= 94500000 91500000 92700000

ͬ����3��ֵ,��˼��:

net.ipv4.tcp_mem[0]:���ڴ�ֵ��TCPû���ڴ�ѹ����

net.ipv4.tcp_mem[1]:�ڴ�ֵ�£������ڴ�ѹ���Ρ�

net.ipv4.tcp_mem[2]:���ڴ�ֵ��TCP�ܾ�����socket��

�����ڴ浥λ��ҳ���������ֽڡ��ɲο����Ż�ֵ��:7864321048576 1572864

net.ipv4.tcp_max_orphans= 3276800

ϵͳ������ж��ٸ�TCP���ֲ����������κ�һ���û��ļ�����ϡ�

�������������֣����ӽ����̱���λ����ӡ��������Ϣ��

������ƽ�����Ϊ�˷�ֹ��DoS���������ܹ���������������Ϊ�ؼ�С���ֵ��

��Ӧ���������ֵ(����������ڴ�֮��)��

net.ipv4.tcp_fin_timeout= 30

��������ɱ���Ҫ��رգ����������������������FIN-WAIT-2״̬��ʱ�䡣�Զ˿��Գ�������Զ���ر����ӣ������������ȱʡֵ��60�롣2.2 �ں˵�ͨ��ֵ��180�룬�����������ã���Ҫ��ס���ǣ���ʹ��Ļ�����һ�����ص�WEB��������Ҳ����Ϊ�����������ֶ��ڴ�����ķ��գ�FIN-WAIT-2��Σ���Ա�FIN-WAIT-1ҪС����Ϊ�����ֻ�ܳԵ�1.5K�ڴ棬�������ǵ������ڳ�Щ��

ͬʱ���漰��һ��TCP ӵ���㷨�����⣬����������������鿴�����ṩ��ӵ���㷨����ģ�飺

sysctlnet.ipv4.tcp_available_congestion_control

���ڼ����㷨�ķ�����������Բο��£�TCPӵ�������㷨����ȱ�㡢���û��������ܷ������������ʱ��������hybla���е���ʱ��������htcp�㷨�ȡ�

���������TCP ӵ���㷨Ϊhybla

net.ipv4.tcp_congestion_control=hybla

����ģ������ں˰������3.7.1�ģ����ǿ��Կ���tcp_fastopen��

net.ipv4.tcp_fastopen= 3

3��ʹ��֧�ָ߲�������I/O�ı�̼������ɲο�Unix������һ�飩

��Linux�ϱ�д�߲���TCP����Ӧ�ó���ʱ������ʹ�ú��ʵ�����I/O������I/O�¼����ɻ��ơ�

���õ�I/O������ͬ��I/O��������ʽͬ��I/O(Ҳ�Ʒ�ӦʽI/O)���Լ��첽I/O���ڸ�TCP�����������£����ʹ��ͬ��I/O��������������������ת������Ϊÿ��TCP���ӵ�I/O����һ���̡߳����ǣ�������߳��ֻ���ϵͳ���̵߳ĵ�����ɾ�������ˣ��ڸ�TCP������������ʹ��ͬ�� I/O�Dz���ȡ�ģ���ʱ���Կ���ʹ�÷�����ʽͬ��I/O���첽I/O��������ʽͬ��I/O�ļ�������ʹ��select()��poll()��epoll�Ȼ��ơ��첽I/O�ļ�������ʹ��AIO��

��I/O�¼����ɻ���������ʹ��select()�Dz����ʵģ���Ϊ����֧�ֵIJ�������������(ͨ����1024������)������������ܣ�poll()Ҳ�Dz����ʵģ�����������֧�ֵĽϸߵ�TCP���������������������“��ѯ”���ƣ����������ϸ�ʱ��������Ч���൱�ͣ������ܴ���I/O�¼����ɲ��������²���TCP�����ϵ�I/O����“����”�������ʹ��epoll��AIO����û����������(����Linux�ں˵�AIO����ʵ����ͨ�����ں���Ϊÿ�� I/O����һ���߳���ʵ�ֵģ�����ʵ�ֻ����ڸ߲���TCP���ӵ�������ʹ����ʵҲ�����ص��������⡣�������µ�Linux�ں��У�AIO��ʵ���Ѿ��õ��Ľ�)��

�����������ڿ���֧�ָ߲���TCP���ӵ�LinuxӦ�ó���ʱ��Ӧ����ʹ��epoll��AIO������ʵ�ֲ�����TCP�����ϵ�I/O���ƣ��⽫Ϊ��������Ը߲���TCP���ӵ�֧���ṩ��Ч��I/O��֤��

4. ��־�������“ java.lang.OutOfMemoryError: ”

������������������ϵͳ��java����

4.1 ����ϵͳ����

һ��ʼ��ӡ����javaӦ�ó����������⣬Ҳ���м�����ϵͳû���������Ż��������༭ /etc/security/limits.conf �ļ�

vi /etc/security/limits.conf

#��

• soft nproc 81920

• hard nproc 81920ע�� * ��ʾ�����û���soft��hard��ʾ�����ơ�Ӳ���ơ���������<=Ӳ���ƣ�

4.2 jvm����IJ�������

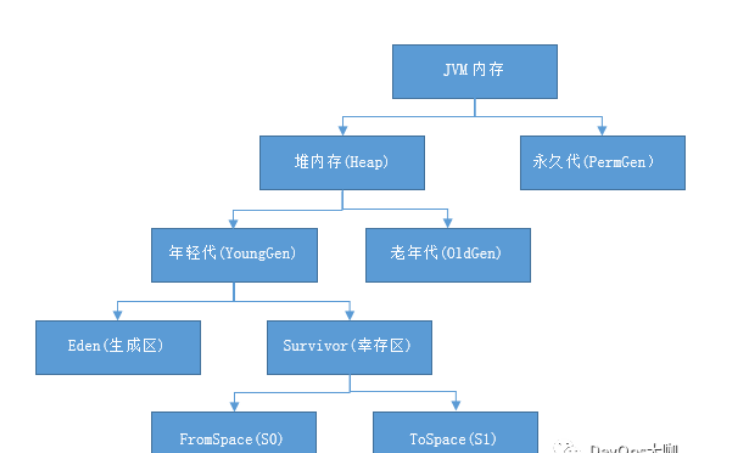

jvm�ṹͼ��

1,JVM�ڴ滮�ַ�Ϊ�������Young Generation�����������Old Generation�������ô���Permanent Generation����

2,������ַ�ΪEden��Survivor����Survivor����FromSpace��ToSpace��ɡ�Eden��ռ��������Survivor������ռС������Ĭ�ϱ��������8:2��

3,���ڴ棨Heap��=�����+��������Ƕ��ڴ�=���ô���

4,���ڴ���;����ŵ��Ƕ��������ռ��������ռ���Щ����Ȼ�����GC�㷨���ա�

5,�Ƕ��ڴ���;��JVM����ʹ�ã����һЩ�ࡢ���������������Եȡ�

6,������������ɵĶ������ȷŵ��������Eden���У���Eden��ʱ������GC�����Ķ����Ƶ�Survivor����FromSpace�У����Survivor����ʱ�����ٱ����Ƶ�Survivor����ToSpace����������д������ٱ����Ƶ��������

7,���������������о���GC���Ķ���ᱻ���Ƶ�������С���������ռ䲻��ʱ��JVM��������������ȫ���������գ�Full GC�������GC��������Ŵ�Survivor�����ƹ����Ķ��ͻ����OOM��Out of Memory����

8,���ô���Ҳ��Ϊ����������ž�̬�������ݣ������ࡢ���������Եȡ�

JVM�ڴ����ò���Խ��Խ�ã����廹�Ǹ�����Ŀ����ʵ��ռ���ڴ��С����������ͨ��Java�Դ��ķ����������鿴��������ù������ӻ���ʱ�䣬�Ӷ�������ͣӦ��ʱ�䣬���Ҵ�δ������ר��Ų̄��������java�����ǻ��ʽ�����������ݿ⣬tomcat��nginx��

#���������Ż�����ֻ�Dzο�

JAVA_OPTS="-server-Xms1024m -Xmx1536m -XX:PermSize=256m -XX:MaxPermSize=512m-XX:+UseConcMarkSweepGC -XX:+UseParallelGCThreads=8XX:CMSInitiatingOccupancyFraction=80 -XX:+UseCMSCompactAtFullCollection-XX:CMSFullGCsBeforeCompaction=0 -XX:-PrintGC -XX:-PrintGCDetails-XX:-PrintGCTimeStamps -Xloggc:/log/java.log"

5. ͨ��tomcat����Դ��ѣ��Ż�����

#ֻ�Dzο���ʵ�ʳ�������Ҫ

<Connectorport="8080"protocol="org.apache.coyote.http11.Http11NioProtocol"

maxThreads="1000"

minSpareThreads="100"

maxSpareThreads="200"

acceptCount="900"

disableUploadTimeout="true"

connectionTimeout="20000"

URIEncoding="UTF-8"

enableLookups="false"

redirectPort="8443"

compression="on"

compressionMinSize="1024"

compressableMimeType="text/html,text/xml,text/css,text/javascript"/> ����˵����

org.apache.coyote.http11.Http11NioProtocol����������ģʽΪNio

maxThreads������߳�����Ĭ��150������ֵ�������������࣬������Ӧ������

minSpareThreads����С�����߳�����

maxSpareThreads���������߳���������������ֵ����ر����õ��̡߳�

acceptCount��������������ֵʱ������������ŵ������еȴ���

disableUploadTimeout�������ϴ���ʱʱ��

connectionTimeout�����ӳ�ʱ����λ���룬0����������

URIEncoding��URI��ַ����ʹ��UTF-8

enableLookups���ر�dns�����������Ӧʱ��

compression������ѹ������

compressionMinSize����Сѹ����С����λByte

compressableMimeType��ѹ�����ļ�����

Tomcat�����ֹ���ģʽ��Bio��Nio��Apr

������˽������ǹ���ԭ����

Bio(BlockingI/O)��Ĭ�Ϲ���ģʽ������ʽI/O������û���κ��Ż��������������ܱȽϵ͡�

Nio(New I/O orNon-Blocking)��������ʽI/O��������Bio�и��õIJ����������ܡ�

Apr(ApachePortable Runtime��Apache����ֲ���п�)����ѡ����ģʽ����ҪΪ�ϲ��Ӧ�ó����ṩһ�����Կ�Խ�����ϵͳƽ̨ʹ�õĵײ�֧�ֽӿڿ⡣

tomcat���û���Apr��tomcat-native��ʵ�ֲ���ϵͳ������ƣ��ṩһ���Ż������ͷ�����ʽI/O�����������߲�������������������Ҫ��װapr��tomcat-native�⡣

��һ�ݲο� �ں˲���sysctl.conf ��ʵ�ʳ���������������

net.ipv4.ip_local_port_range = 1024 65536

net.core.rmem_max=16777216

net.core.wmem_max=16777216

net.ipv4.tcp_rmem=4096 87380 16777216

net.ipv4.tcp_wmem=4096 65536 16777216

net.ipv4.tcp_fin_timeout = 10

net.ipv4.tcp_tw_recycle = 1

net.ipv4.tcp_timestamps = 0

net.ipv4.tcp_window_scaling = 0

net.ipv4.tcp_sack = 0

net.core.netdev_max_backlog = 30000

net.ipv4.tcp_no_metrics_save=1

net.core.somaxconn = 262144

net.ipv4.tcp_syncookies = 0

net.ipv4.tcp_max_orphans = 262144

net.ipv4.tcp_max_syn_backlog = 262144

net.ipv4.tcp_synack_retries = 2

net.ipv4.tcp_syn_retries = 2�ܽ��������ϣ��������������д������ѧ��linux����java��ҵ��Ա���������Ƽ������顶������������ϵͳ����Unix�����̾�1

ԭ������:https://www.cnblogs.com/dongguangming/p/12631517.html

������������ԭ������ϵ

��ǩ��

��Ȩ��������վ���²��������磬������Ȩ������ϵ��west999com@outlook.com

�ر�ע�⣺��վ����ת���������۲�������վ�۵㣬��վ���ṩ����Ӱ��Ƭ���廭�������Ʒ������ʹ�ã�����ԭ������ϵ����Ȩ��ԭ��������

��һƪ��jmeter ��װ

��һƪ��java �����������Ͷ����װ��

- �������Ա������Java��Դ��ȫ��ȫ���Ǹɻ��� 2020-06-12

- 2020�������й�ƽ��������Java�м���������ϼ������𰸣� 2020-06-11

- 2020��java��ҵǰ�� 2020-06-11

- 04.Java����� 2020-06-11

- Java--����(�����Ƶ����)���� 2020-06-11

IDC��Ѷ�� ������Ѷ ע����Ѷ �й���Ѷ vps��Ѷ ��վ����

��վ��Ӫ�� ��վ���� ��ӯ�� �����Ż� ��վ�ƹ� �����Դ

��վ���ˣ� �������� ���˽��� ���˵��� ������

��ҵ��Ѷ�� �������� ������Ϸ �������� ��洫ý

�����̣� Asp.Net��� Asp��� Php��� Xml��� Access Mssql Mysql ����

������������ Web������ Ftp������ Mail������ Dns������ ��ȫ����

�������ɣ� �������� Word Excel Powerpoint Ghost Vista QQ�ռ� QQ FlashGet Ѹ��

��ҳ������ FrontPages Dreamweaver Javascript css photoshop fireworks Flash

������ƣ� Java���� C/C++ VB delphi

- ʲô�������Ե�ȡ�ź�����,��ô����

- ����������վ����2020�����

- springcloudѧϰ֮·: (һ) ��Ĵ�

- ����Gradle���̳���Could not install

- ����Ū����PKIX path building failed

- Tomcat��������:org.apache.catalina.L

- spring boot ����Check your ViewRes

- ����HttpClient���°���������ϵͳģ��

- ֻ�г���Ա���ܿ����ij��ƣ�������Ȼ��

- mybatis ע��@Results��@Result��@Resu